반응형

OpenVINO?

- OpenVINO는 Intel에서 개발한 크로스 플랫폼이다.

- Pytorch, TF, ONNX 등의 딥러닝 프레임워크 모델을 Intel device에 최적화된 모델로 변환해 준다.

- 주로 Intel CPU 장비에서 Inference 할 목적으로 사용.

OpenVINO 설치

간단하게 아래 CLI로 설치 가능하다.

pip install openvino-dev>=2023.0

YOLOv8 Convert

2023.07.21 - [DeepLearning/YOLO] - [YOLOv8] YOLOv8 install windows 10

[YOLOv8] YOLOv8 install windows 10

YOLOv8 설치 정리 https://github.com/ultralytics/ultralytics GitHub - ultralytics/ultralytics: NEW - YOLOv8 🚀 in PyTorch > ONNX > OpenVINO > CoreML > TFLite NEW - YOLOv8 🚀 in PyTorch > ONNX > OpenVINO > CoreML > TFLite - GitHub - ultralytics/ultra

wjs7347.tistory.com

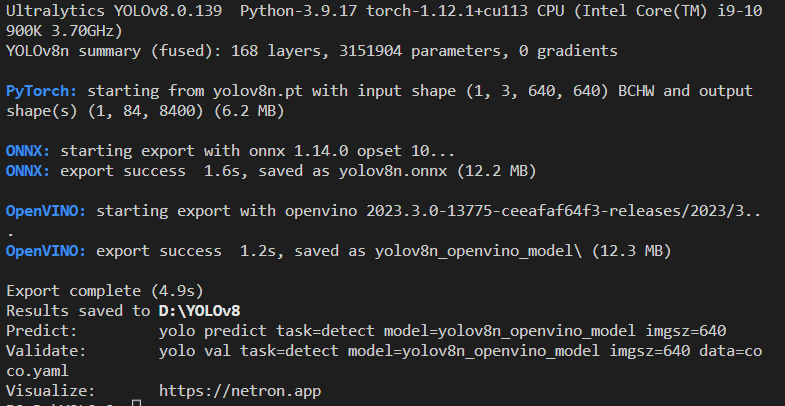

- 앞서 설치한 YOLOv8에서 OpenVINO 모델로 Export 할 수 있다.

from ultralytics import YOLO

import cv2

model = YOLO('yolov8n.pt') # pytorch model load

model.export(format='openvino') # openvino format으로 export

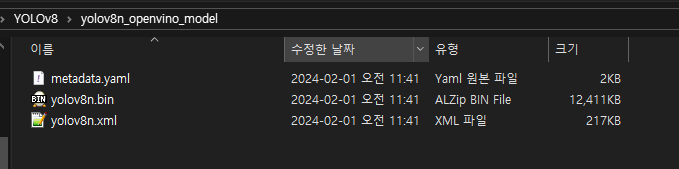

- export가 성공하면 "yolov8n_openvino_model' 경로가 자동으로 생성.

- 폴더 안에 .yaml, .bin, .xml 3개의 파일로 OpenVINO 모델이 생성된다.

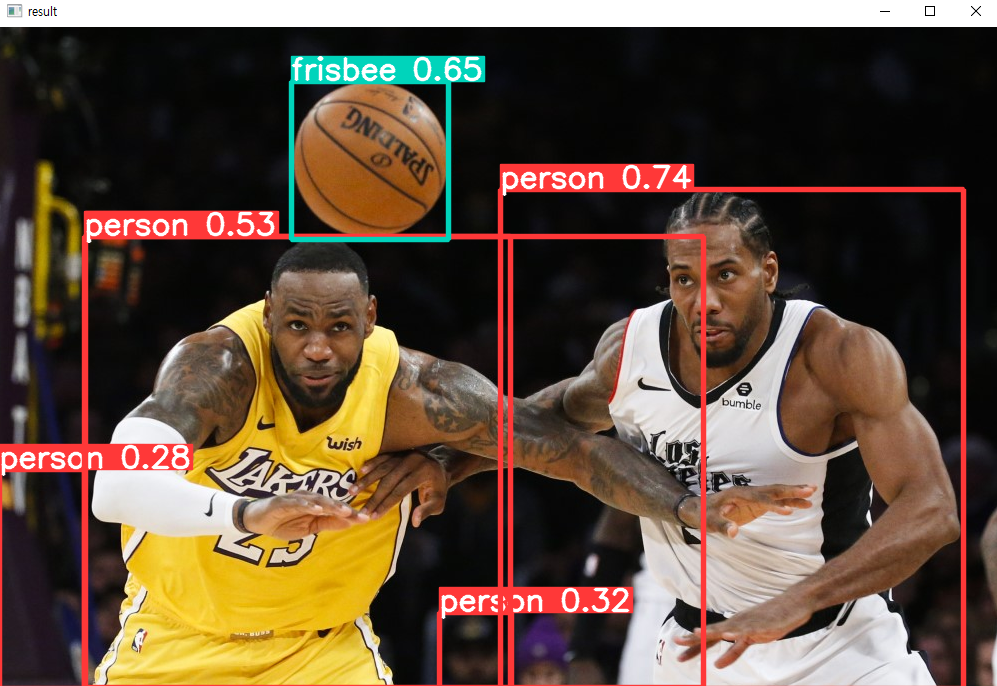

Inference

- Convert와 마찬가지로 yolov8 라이브러리를 사용하여 OpenVINO 모델로 추론할 수 있다.

from ultralytics import YOLO

import cv2

ov_model = YOLO('yolov8n_openvino_model/') # openvino model load

image_path = 'D:/YOLOv8/test_image.jpg'

result = ov_model(image_path)

result_plotted = result[0].plot()

cv2.imshow("result", result_plotted)

cv2.waitKey(0)

반응형

'DeepLearning > YOLO' 카테고리의 다른 글

| [YOLO] YOLOv11 Object Segmentation (0) | 2024.11.12 |

|---|---|

| [YOLOv8] YOLOv8 Custom Train, 사용자 데이터 학습 (0) | 2023.11.14 |

| [YOLOv8] YOLOv8 TensorRT C++(CPP) Inference (15) | 2023.09.04 |

| [YOLOv8] YOLOv8 Export, Pytorch -> ONNX -> TensorRT (0) | 2023.07.26 |

| [YOLOv8] YOLOv8 Export, Pytorch to TensorRT (0) | 2023.07.21 |